Sau hai thập kỷ phát triển, CUDA đã trở thành nền tảng phần mềm cốt lõi giúp NVIDIA xây dựng hệ sinh thái GPU và thống trị hạ tầng tính toán cho trí tuệ nhân tạo.

Tại sự kiện NVIDIA GTC 2026, CEO Jensen Huang đã dành một phần đáng kể trong bài keynote để nhắc lại một cột mốc đặc biệt: 20 năm của CUDA – nền tảng phần mềm đã trở thành trái tim của hệ sinh thái GPU và là một trong những yếu tố quan trọng giúp NVIDIA vươn lên vị trí trung tâm của cuộc cách mạng trí tuệ nhân tạo.

Theo Huang, hành trình của CUDA bắt đầu từ một ý tưởng tưởng chừng đơn giản nhưng mang tính cách mạng: biến GPU thành một nền tảng tính toán song song có thể lập trình dễ dàng cho mọi nhà phát triển.

Từ GPU đồ họa đến nền tảng AI toàn cầu

Ra đời năm 2006, CUDA được xây dựng dựa trên kiến trúc Single Instruction Multiple Thread (SIMT), cho phép hàng nghìn lõi xử lý của GPU thực hiện các phép tính song song một cách hiệu quả.

Thời điểm đó, GPU chủ yếu phục vụ đồ họa máy tính và game. Tuy nhiên, CUDA đã mở ra một hướng đi hoàn toàn mới: biến GPU thành bộ tăng tốc cho các bài toán khoa học và dữ liệu quy mô lớn.

Theo Jensen Huang, việc viết các ứng dụng tính toán song song bằng CUDA dễ dàng hơn rất nhiều so với các mô hình lập trình song song trước đây, từ đó mở rộng cộng đồng lập trình viên.

Hai thập kỷ sau, CUDA đã phát triển thành một hệ sinh thái khổng lồ với: Hàng trăm nghìn dự án mã nguồn mở, hàng triệu nhà phát triển và hàng trăm triệu GPU được triển khai trên toàn thế giới.

CUDA cũng được tích hợp sâu vào hầu hết các framework AI phổ biến, biến nó trở thành nền tảng gần như mặc định cho việc huấn luyện và triển khai mô hình trí tuệ nhân tạo.

Hệ sinh thái phần mềm khổng lồ

Một trong những yếu tố quan trọng giúp CUDA thành công là hệ sinh thái phần mềm xung quanh nó.

Trong bài keynote, Huang nhấn mạnh rằng NVIDIA đã xây dựng hàng nghìn công cụ, thư viện và framework nhằm hỗ trợ lập trình viên tối ưu hóa hiệu năng GPU.

Những thư viện này bao phủ gần như toàn bộ lĩnh vực khoa học và kỹ thuật, từ mô phỏng vật lý, xử lý dữ liệu, khoa học sinh học, trí tuệ nhân tạo, đồ họa máy tính.

Nhờ đó, các nhà phát triển có thể tận dụng sức mạnh GPU mà không cần phải viết mọi thuật toán từ đầu.

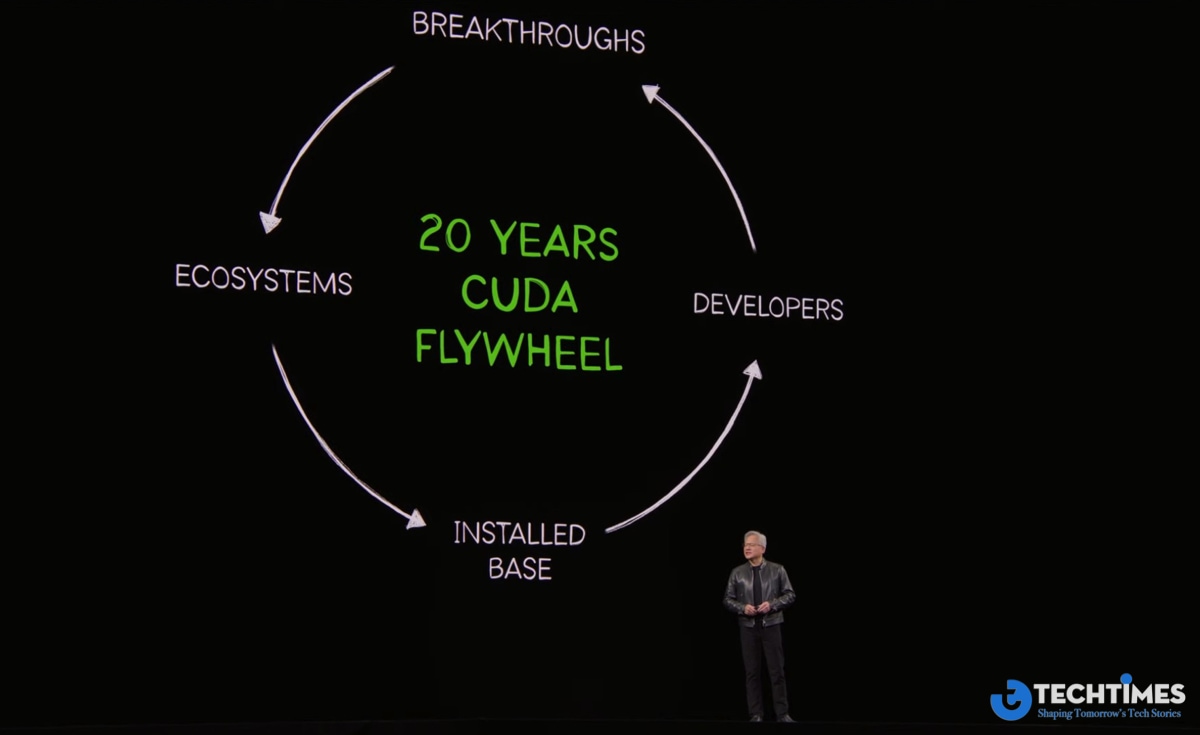

Huang gọi đây là ““flywheel” (bánh đà) của hệ sinh thái CUDA, khi số lượng GPU cài đặt tăng lên, nhiều nhà phát triển tham gia hơn, nhiều ứng dụng mới xuất hiện hơn – và điều đó lại tiếp tục thúc đẩy việc triển khai GPU trên quy mô lớn.

Đặt nền móng cho bùng nổ AI

Một trong những bước ngoặt lớn nhất của CUDA đến khi các nhà nghiên cứu phát hiện GPU có thể tăng tốc quá trình huấn luyện mạng nơ-ron. Sự kiện này được Huang mô tả như “Vụ nổ Big Bang của AI hiện đại”.

Các framework học sâu phổ biến như PyTorch hay TensorFlow đều phụ thuộc sâu vào CUDA để khai thác hiệu năng GPU.

Chính điều này đã khiến GPU của NVIDIA trở thành hạ tầng mặc định cho đào tạo mô hình AI, từ startup cho đến các phòng thí nghiệm lớn.

Lợi thế chiến lược của NVIDIA

Theo Huang, CUDA không chỉ là một nền tảng phần mềm mà còn là lợi thế chiến lược dài hạn của NVIDIA.

Trong suốt 20 năm qua, công ty đã liên tục tối ưu hóa phần mềm để tăng hiệu năng tính toán, giảm chi phí xử lý, kéo dài vòng đời của hạ tầng GPU.

Nhờ việc cập nhật phần mềm liên tục, các hệ thống GPU cũ vẫn có thể đạt hiệu năng cao hơn theo thời gian khi các thuật toán được cải tiến.

Điều này giúp các trung tâm dữ liệu và doanh nghiệp tối đa hóa giá trị đầu tư vào hạ tầng AI.

Nền móng cho tương lai AI

Từ đồ họa máy tính đến trí tuệ nhân tạo, CUDA đã trở thành nền tảng trung tâm của hệ sinh thái tính toán tăng tốc.

Hai thập kỷ sau khi ra đời, CUDA không còn chỉ là công cụ cho lập trình viên GPU mà đã trở thành xương sống của hạ tầng AI toàn cầu.

Và theo CEO Jensen Huang của NVIDIA, hành trình đó mới chỉ bắt đầu.

“Khi số lượng ứng dụng và nhà phát triển tiếp tục tăng, hệ sinh thái CUDA sẽ tiếp tục mở rộng – và đó chính là động lực giúp AI tiến xa hơn nữa,” ông nói.