Tại sao nó quan trọng: Trong bài phát biểu quan trọng của GTC 2023, Giám đốc điều hành Jensen Huang của Nvidia đã nêu bật một thế hệ đột phá mới nhằm đưa AI đến mọi ngành công nghiệp. Hợp tác với những gã khổng lồ công nghệ như Google, Microsoft và Oracle, Nvidia đang đạt được những tiến bộ trong đào tạo AI, triển khai, chất bán dẫn, thư viện phần mềm, hệ thống và dịch vụ đám mây. Các quan hệ đối tác và phát triển khác được công bố bao gồm Adobe, AT&T và nhà sản xuất phương tiện BYD.

Hoàng lưu ý nhiều ví dụ về hệ sinh thái của Nvidia đang hoạt động, bao gồm cả việc người dùng Microsoft 365 và Azure có quyền truy cập vào nền tảng để xây dựng thế giới ảo và Amazon sử dụng khả năng mô phỏng để huấn luyện rô-bốt kho hàng tự động. Ông cũng đề cập đến sự gia tăng nhanh chóng của các dịch vụ AI tổng quát như ChatGPT, gọi thành công của nó là “thời điểm iPhone của AI”.

Dựa trên kiến trúc Hopper của Nvidia, Huang đã công bố GPU H100 NVL mới hoạt động trong cấu hình GPU kép với NVLink, để đáp ứng nhu cầu ngày càng tăng về AI và suy luận mô hình ngôn ngữ lớn (LLM). GPU có Công cụ biến áp được thiết kế để xử lý các mô hình như GPT, giúp giảm chi phí xử lý LLM. Công ty tuyên bố, so với HGX A100 để xử lý GPT-3, một máy chủ có bốn cặp H100 NVL có thể nhanh hơn gấp 10 lần.

Với việc điện toán đám mây trở thành ngành công nghiệp trị giá 1 nghìn tỷ USD, Nvidia đã phát triển CPU Grace dựa trên Arm cho khối lượng công việc AI và đám mây. Công ty tuyên bố hiệu suất gấp 2 lần so với bộ xử lý x86 ở cùng mức năng lượng trên các ứng dụng trung tâm dữ liệu lớn. Sau đó, siêu chip Grace Hopper kết hợp CPU Grace và GPU Hopper để xử lý các bộ dữ liệu khổng lồ thường thấy trong cơ sở dữ liệu AI và các mô hình ngôn ngữ lớn.

Hơn nữa, Giám đốc điều hành của Nvidia tuyên bố nền tảng DGX H100 của họ, có tám GPU Nvidia H100, đã trở thành kế hoạch chi tiết để xây dựng cơ sở hạ tầng AI. Một số nhà cung cấp đám mây lớn, bao gồm Oracle Cloud, AWS và Microsoft Azure, đã công bố kế hoạch áp dụng GPU H100 trong các dịch vụ của họ. Các nhà sản xuất máy chủ như Dell, Cisco và Lenovo cũng đang tạo ra các hệ thống được cung cấp bởi GPU Nvidia H100.

Vì rõ ràng, các mô hình AI tổng quát đang thịnh hành, Nvidia đang cung cấp các sản phẩm phần cứng mới với các trường hợp sử dụng cụ thể để chạy các nền tảng suy luận hiệu quả hơn. GPU L4 Tensor Core mới là bộ tăng tốc phổ quát được tối ưu hóa cho video, mang lại hiệu suất video được hỗ trợ bởi AI tốt hơn 120 lần và hiệu suất năng lượng được cải thiện 99% so với CPU, trong khi L40 cho Tạo hình ảnh được tối ưu hóa cho đồ họa và 2D hỗ trợ AI , video và tạo hình ảnh 3D.

Cũng đọc: Nvidia đã giành được thị trường đào tạo AI chưa?

Nvidia’s Omniverse cũng có mặt trong quá trình hiện đại hóa ngành công nghiệp ô tô. Đến năm 2030, ngành công nghiệp này sẽ đánh dấu sự chuyển hướng sang xe điện, nhà máy mới và siêu nhà máy pin. Nvidia cho biết Omniverse đang được các thương hiệu ô tô lớn áp dụng cho nhiều nhiệm vụ khác nhau: Lotus sử dụng nó để lắp ráp trạm hàn ảo, Mercedes-Benz để lập kế hoạch và tối ưu hóa dây chuyền lắp ráp, và Lucid Motors để xây dựng các cửa hàng kỹ thuật số với dữ liệu thiết kế chính xác. BMW hợp tác với các công trình lý tưởng để đào tạo robot nhà máy và lên kế hoạch cho một nhà máy sản xuất xe điện hoàn toàn trong Omniverse.

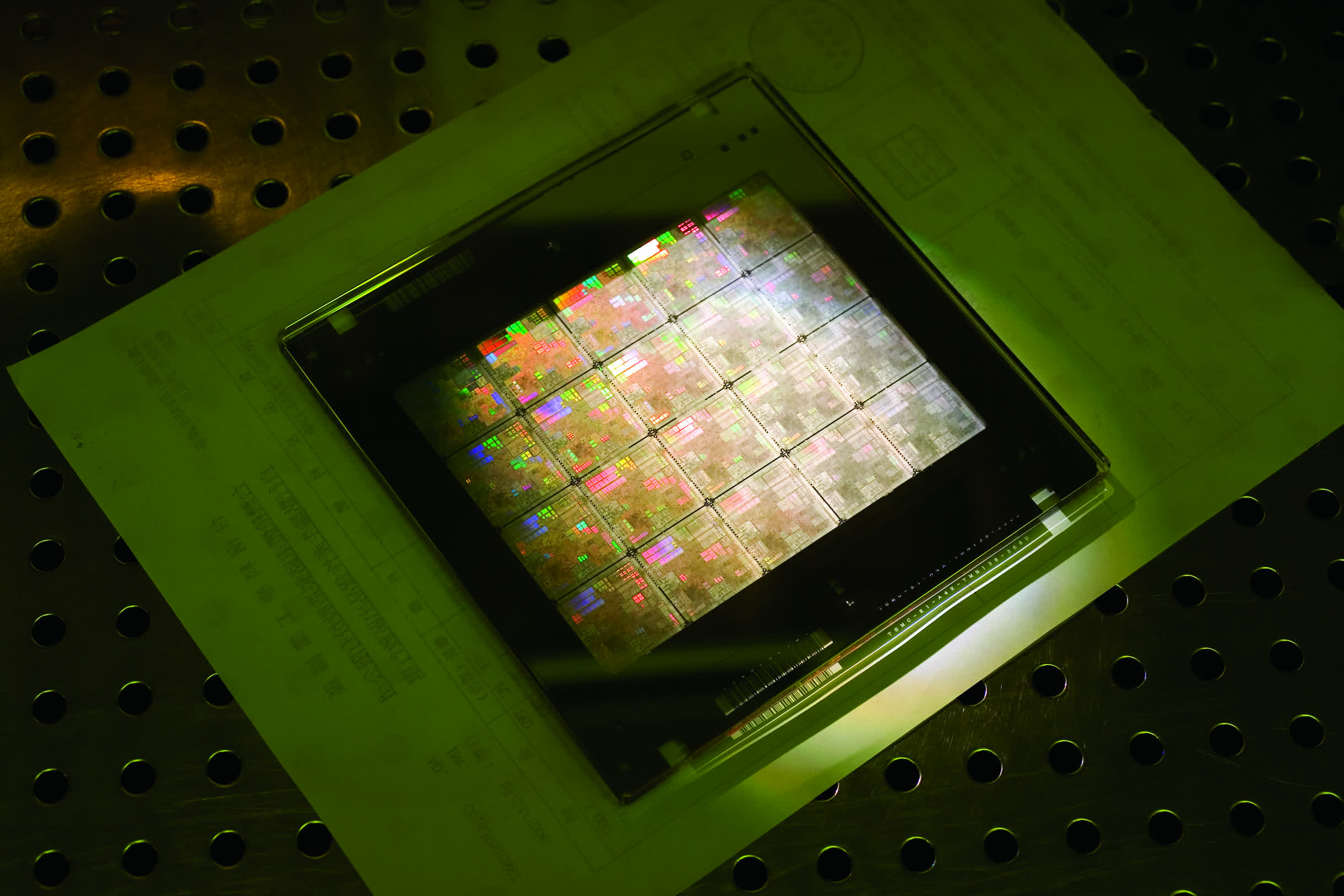

Tất cả trong tất cả, đã có quá nhiều thông báo và quan hệ đối tác phải đề cập, nhưng có thể nói rằng cột mốc quan trọng cuối cùng đến từ phía sản xuất. Nvidia đã công bố một bước đột phá trong tốc độ sản xuất chip và hiệu quả năng lượng với việc giới thiệu “cuLitho”, một thư viện phần mềm được thiết kế để tăng tốc độ in thạch bản tính toán lên đến 40 lần.

Jensen giải thích rằng cuLitho có thể giảm đáng kể các tính toán mở rộng và xử lý dữ liệu cần thiết trong thiết kế và sản xuất chip. Điều này sẽ dẫn đến mức tiêu thụ điện và tài nguyên thấp hơn đáng kể. TSMC và nhà cung cấp thiết bị bán dẫn ASML có kế hoạch kết hợp cuLitho trong quy trình sản xuất của họ.