Điều gì vừa xảy ra? Đó là trường hợp của một ngày khác, một cảnh báo khác về khả năng AI gây ra sự tuyệt chủng của loài người. Nhân dịp này, người ta đã so sánh nó với những rủi ro do chiến tranh hạt nhân và đại dịch gây ra. Tuyên bố đến từ các chuyên gia trong lĩnh vực này và những người đứng sau các hệ thống này, bao gồm cả Giám đốc điều hành OpenAI Sam Altman.

AI có tiêu đề đáng lo ngại Tuyên bố tuyệt chủng từ Trung tâm An toàn AI (CAIS) được ký bởi các CEO từ các phòng thí nghiệm AI hàng đầu: Altman, Demis Hassabis của Google DeepMind và Dario Amodei của Anthropic. Những bên ký kết khác bao gồm các tác giả của sách giáo khoa về trí tuệ nhân tạo và học sâu, những người đoạt giải thưởng Turing như Geoffrey Hinton (người đã rời Google vì nỗi sợ hãi về trí tuệ nhân tạo của mình), giám đốc điều hành từ các công ty công nghệ hàng đầu, nhà khoa học, giáo sư, v.v.

Tuyên bố chỉ vỏn vẹn một câu: “Giảm thiểu nguy cơ tuyệt chủng do AI phải là ưu tiên toàn cầu bên cạnh các rủi ro quy mô xã hội khác như đại dịch và chiến tranh hạt nhân.”

Một số rủi ro AI liệt kê bởi CAIS bao gồm việc duy trì sự thiên vị, cung cấp năng lượng cho vũ khí tự trị, thúc đẩy thông tin sai lệch và tiến hành các cuộc tấn công mạng. Tổ chức viết rằng khi AI trở nên tiên tiến hơn, nó có thể gây ra những rủi ro thảm khốc hoặc hiện hữu.

Vũ khí hóa là một mối quan tâm đặc biệt đối với CAIS. Nó viết rằng các tác nhân độc hại có thể tái sử dụng AI để có sức phá hoại cao. Một ví dụ được đưa ra là các công cụ khám phá ma túy học máy đang được sử dụng để chế tạo vũ khí hóa học.

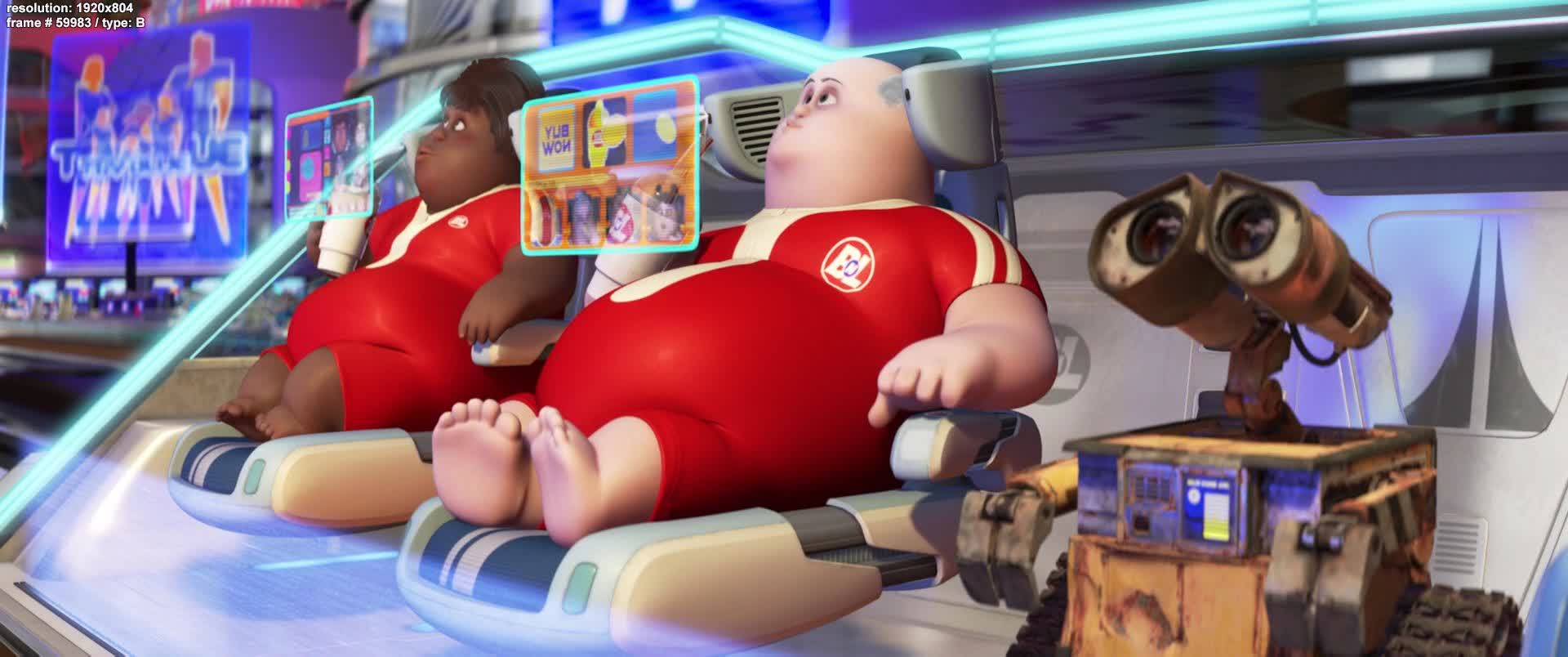

Thông tin sai lệch do AI tạo ra có thể khiến xã hội ít được trang bị hơn để xử lý những thay đổi quan trọng và các hệ thống này có thể tìm ra những cách mới để theo đuổi mục tiêu của mình bằng cách đánh đổi các giá trị cá nhân và xã hội. Ngoài ra còn có nguy cơ suy yếu, trong đó các cá nhân trở nên hoàn toàn phụ thuộc vào máy móc. CAIS so sánh kịch bản này với kịch bản trong WALL-E.

Giám đốc CAIS Dan Hendrycks nói: “Thế giới đã hợp tác thành công để giảm thiểu rủi ro liên quan đến chiến tranh hạt nhân. Cần có mức độ nỗ lực tương tự để giải quyết những nguy cơ do các hệ thống AI trong tương lai gây ra”. Đăng ký.

Không chỉ những người liên quan đến AI lo sợ công nghệ này có thể dẫn đến đâu. Hơn hai phần ba người Mỹ tin rằng nó có thể đe dọa nền văn minh, mặc dù hầu hết người Mỹ trưởng thành chưa bao giờ sử dụng ChatGPT. Chúng tôi cũng đã nghe Warren Buffett so sánh AI với việc chế tạo bom nguyên tử.

Việc đưa Altman vào danh sách các bên ký kết được đưa ra sau khi OpenAI kêu gọi thành lập một cơ quan giám sát toàn cầu để giám sát sự phát triển của AI. Tuy nhiên, một số người cho rằng lời cầu xin của ông về quy định chỉ nhằm kìm hãm sự đổi mới của các đối thủ và giúp công ty của ông đứng đầu.

Trở lại vào tháng 3, một nhóm gồm những bộ óc công nghệ hàng đầu thế giới đã ký một lá thư yêu cầu tạm dừng phát triển AI tiên tiến trong sáu tháng. Elon Musk là một trong những người ký tên, nhưng tên của anh ta bị thiếu trong tuyên bố CAIS. Altman đã xác nhận vào tháng 4 rằng OpenAI hiện không đào tạo GPT-5.

Những cảnh báo về việc AI sẽ hủy diệt loài người đã xuất hiện trong nhiều năm, nhưng sự tiến bộ của các hệ thống này vào năm 2023 đã làm dấy lên nỗi sợ hãi hơn bao giờ hết. Những tuyên bố liên tục như tuyên bố mới nhất này hầu như không giúp giảm bớt những lo ngại của công chúng, nhưng có lý do chính đáng khiến quy định là cần thiết và các công ty khó có thể tự thực hiện nó mà không gặp áp lực.