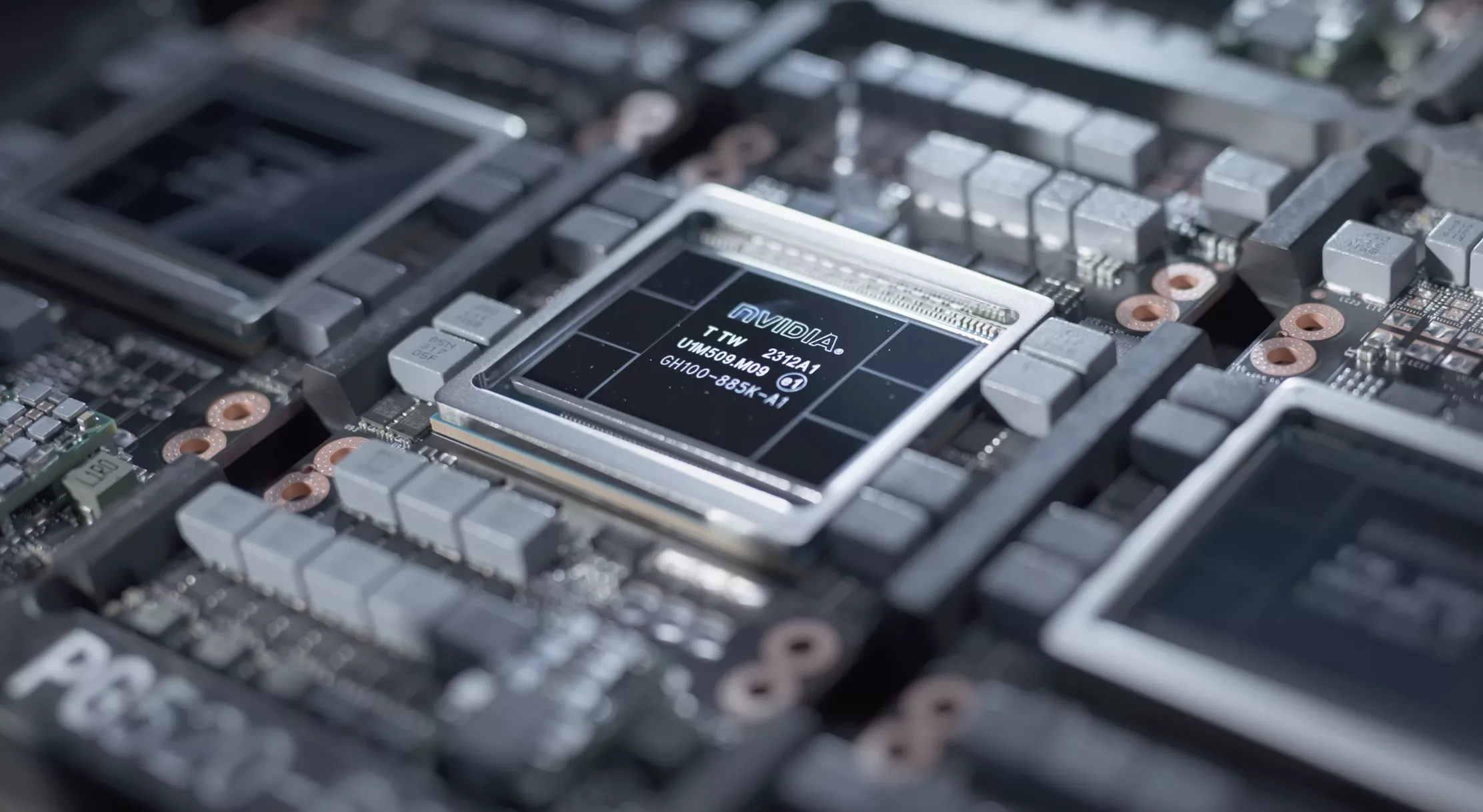

Nvidia tuần này được giới thiệu một đơn vị xử lý quái vật mới dành cho khối lượng công việc AI, HGX H200. Đúng như tên gọi, con chip mới này là sự kế thừa của GPU H100 Tensor Core cực kỳ phổ biến, ra mắt vào năm 2022 khi làn sóng cường điệu AI bắt đầu tăng tốc.

Team Green đã công bố nền tảng mới trong hội nghị Siêu máy tính 2023 ở Denver, Colorado. Dựa trên kiến trúc Hopper, H200 dự kiến sẽ mang lại tốc độ suy luận gần gấp đôi so với H100 trên Llama 2, một mô hình ngôn ngữ lớn (LLM) với 70 tỷ tham số. H200 cũng cung cấp tốc độ suy luận gấp khoảng 1,6 lần khi sử dụng mô hình GPT-3, có 175 tỷ tham số.

Một số cải tiến về hiệu suất này đến từ những cải tiến về kiến trúc, nhưng Nvidia cho biết họ cũng đã thực hiện công việc tối ưu hóa sâu rộng về mặt phần mềm. Điều này được phản ánh trong việc phát hành gần đây các thư viện phần mềm nguồn mở như TenorRT-LLM có thể mang lại hiệu suất cao hơn tới tám lần và mức tiêu thụ năng lượng thấp hơn tới sáu lần khi sử dụng LLM mới nhất cho AI tổng hợp.

Một điểm nổi bật khác của nền tảng H200 là nó là nền tảng đầu tiên sử dụng thông số kỹ thuật mới nhất, bộ nhớ HBM3e. Tổng băng thông bộ nhớ của GPU Tensor Core mới là con số khổng lồ 4,8 terabyte mỗi giây, nhanh hơn một chút so với 3,35 terabyte mỗi giây mà hệ thống con bộ nhớ của H100 đạt được. Tổng dung lượng bộ nhớ cũng tăng từ 80 GB trên H100 lên 141 GB trên nền tảng H200.

Nvidia cho biết H200 được thiết kế để tương thích với các hệ thống tương tự hỗ trợ GPU H100. Điều đó nói lên rằng, H200 sẽ có sẵn ở một số dạng thức chẳng hạn như bo mạch máy chủ HGX H200 với cấu hình bốn hoặc tám chiều hoặc dưới dạng Siêu chip GH200 Grace Hopper, nơi nó sẽ được ghép nối với CPU dựa trên Arm 72 lõi mạnh mẽ trên cùng một Cái bảng. GH200 sẽ cho phép tổng hợp bộ nhớ băng thông cao lên tới 1,1 terabyte và hiệu suất FP8 32 petaflop cho các ứng dụng học sâu.

Cũng giống như GPU H100, siêu chip Hopper mới sẽ có nhu cầu cao và có mức giá hấp dẫn. Một chiếc H100 được bán với giá ước lượng 25.000 USD đến 40.000 USD tùy thuộc vào khối lượng đặt hàng và nhiều công ty trong lĩnh vực AI đang mua hàng nghìn chiếc. Điều này buộc các công ty nhỏ hơn phải đối tác lên chỉ để có được quyền truy cập hạn chế vào GPU AI của Nvidia và thời gian thực hiện dường như không hề ngắn hơn theo thời gian.

Nói về thời gian sản xuất, Nvidia đang kiếm được lợi nhuận khổng lồ trên mỗi H100 được bán ra, do đó, hãng thậm chí còn chuyển một số hoạt động sản xuất từ dòng RTX 40 sang sản xuất nhiều GPU Hopper hơn. Kristin Uchiyama của Nvidia cho biết nguồn cung sẽ không phải là vấn đề vì công ty đang liên tục nỗ lực bổ sung thêm năng lực sản xuất nhưng từ chối cung cấp thêm thông tin chi tiết về vấn đề này.

Có một điều chắc chắn – Team Green quan tâm nhiều hơn đến việc bán GPU tập trung vào AI, vì doanh số bán chip Hopper chiếm phần lớn doanh thu của họ. Họ thậm chí còn phải mất nhiều thời gian để phát triển và sản xuất các phiên bản rút gọn của chip A100 và H100 chỉ để lách các biện pháp kiểm soát xuất khẩu của Mỹ và chuyển chúng cho các gã khổng lồ công nghệ Trung Quốc. Điều này khiến bạn khó có thể quá phấn khích về các card đồ họa RTX 4000 Super sắp ra mắt, vì tính sẵn có sẽ là một yếu tố góp phần lớn vào giá bán lẻ của chúng.

Microsoft Azure, Google Cloud, Amazon Web Services và Cơ sở hạ tầng đám mây Oracle sẽ là những nhà cung cấp đám mây đầu tiên cung cấp quyền truy cập vào các phiên bản dựa trên H200 bắt đầu từ quý 2 năm 2024.